А сегодня поговорим про А/B тесты 📊

А/B тесты - это важная часть работы над продуктом.

Тест позволяют сравнить несколько версий продукта и определить, как изменения влияют на целевые показатели, конверсию📏📉

Например, ухудшение performance и замер результатов через эксперимент - быстрый способ проверить насколько performance важен для вашей аудитории.

Еще ухудшающие эксперименты помогают отделить чувствительные метрики от не чувствительных

Во-первых одновременность замера версии с изменениями и без. Нужно как можно сильнее исключить сторонние факторы.

В общем, статистика предоставляет нам следующий порядок рассуждений для проверки гипотез 👇:

2) Выбираем контрольную группу (выборка А) без изменений и группу с изменениями (выборка В)

3) Выдвигаем нашу нулевую гипотезу (H0): "выборка А и В принадлежат одной ГС, между ними нет разницы".

Применяем относительно H0 правило: "Отклоняем тихо, оставляем громко".

Т.е. нулевая гипотеза верна, пока нет достаточных оснований ее опровергнуть.

Часто применяют порог 0,05 или 0,1.

Читается это так - если p-value ниже 0,05 порога то можно с 95 %-ной вероятностью утверждать, что есть статистически значимые отличия между выборками.

Для 0.1 это соответственно 90%.

В тоже время бывают варианты и с меньшей степенью вероятности, например 0,2.

Иногда готовые системы аналитики и a/b тестирования предлагают такие.

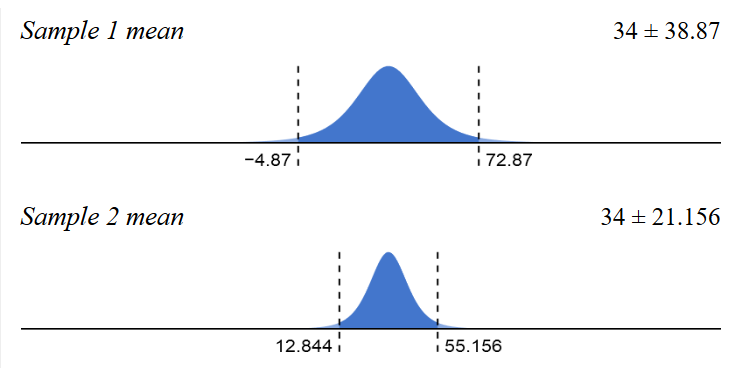

Статистическая мощность зависит от размера выборок и силе различий между ними

Разница называется статистически значимой, когда достигнутая разница между выборками маловероятна, если предположить, что обе выборки принадлежат одной генеральной совокупности (т.е. верна H0).

Можно либо напрямую рассчитать p-value, либо построить доверительный интервал.

Просто вероятность разницы

Насколько большая разница - не говорит ❕

А так бывают еще разные виды экспериментов, поправки к данным, есть байесовский метод и т.д.

А ничего - просто мы не смогли подтвердить H1

Большинство экспериментов не показывают результат, это нормально

Нужно настроиться на это заранее и не расстраиваться потом😀

Не тестировать все подряд, а только реальные гипотезы, которые как-то логически обоснованно могут повлиять на целевые метрики.

Получится ли набрать необходимую статистическую мощность - лучше считать заранее.

Напомню, что на нее влияет как размер выборки, так и чувствительность целевой метрики.

Если эксперимент нацелен только на проверку поведения не зарегистрированных пользователей или только платящих, то и в сегмент отбирайте только их, а не всех подряд.

Обращайте внимание и на используемое значение p-value

Часто если тест определяет победителя довольно быстро - то просто подождите еще) Он еще может поменяться

До недавнего времени у нас их еще не было.

Поразмыслив с @tereznikof (наш продакт), решили что пора начинать что-то пробовать

С него и начали.

К тому же Firebase одна из аналитик, которой мы пользуемся. Уже настроена куча ивентов, по которым можно мерять конверсию и User Property, по которым можно сегментировать пользователей.