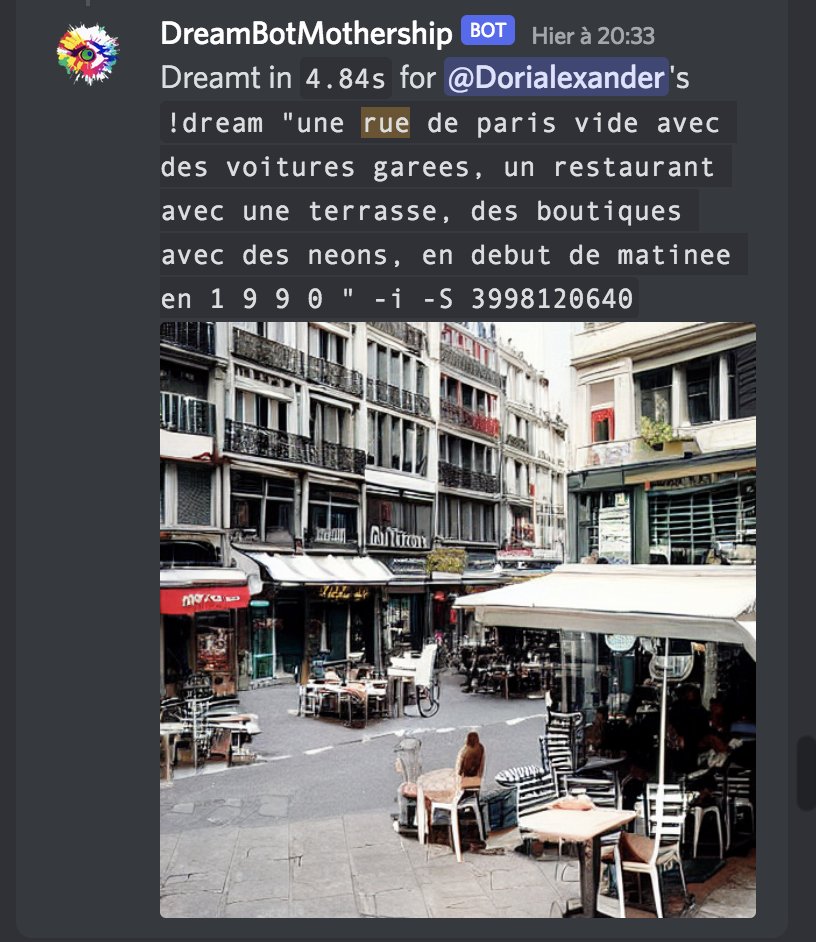

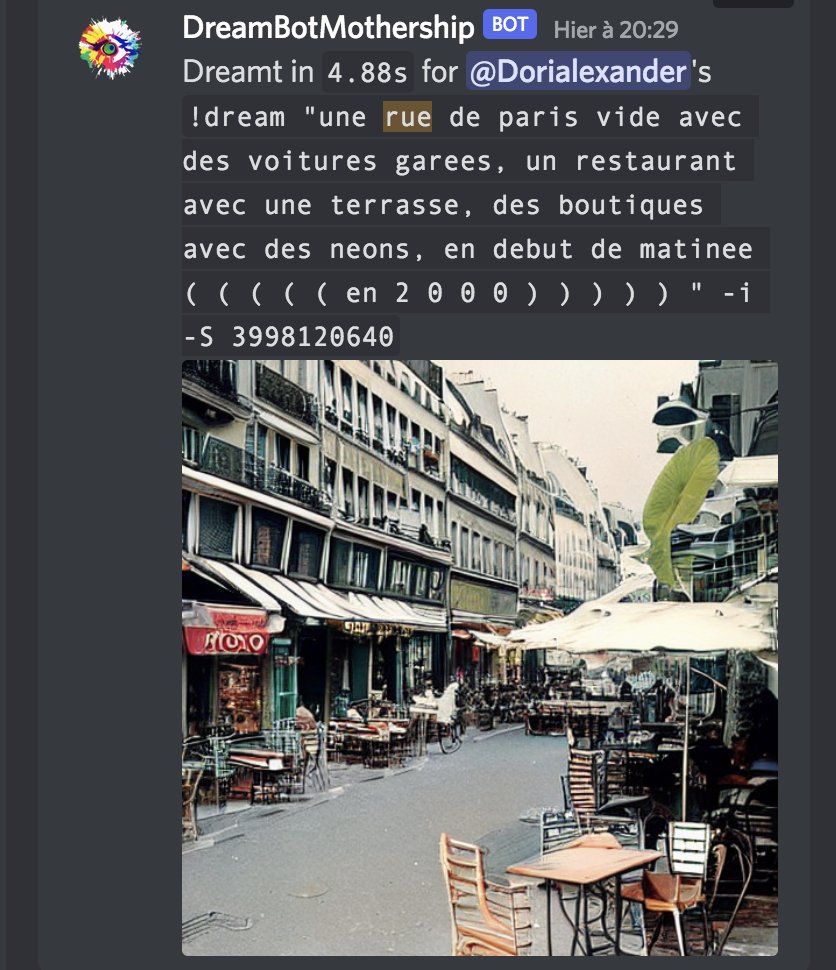

Premier essai de vidéo générée avec #stablediffusion : la transformation d'une rue de Paris au 20e siècle.

(Essai ouvertement inspiré de l'évolution de ce salon américain entre 1940 et 2040)

https://twitter.com/Ted_Underwood/status/1557574592071352320

J'ai un peu détaillé la méthode hier : au-lieu de générer une image complètement neuve, on part de l'identifiant du "point de départ" utilisé par le modèle et on change juste un petit détail.

https://twitter.com/Dorialexander/status/1558832518052421634

Ici le détail changeant, c'était juste l'année de prise de la photographie. Je suis remonté comme ça jusqu'au 19e siècle.

Un petit constat d'ailleurs au passage : malgré l'utilisation d'un point de départ fixe l'image générée n'est pas toujours stable, en particulier lorsque le modèle considère que texte introduit un changement important dans la représentation visuelle.

Et sans surprise les moments les plus compliqués pour représenter une visualisation historique correspondent à moments de ruptures dans les représentations visuelles : 1830-1840, 1910-1920, 1960-1970 et 1990-2000.

• • •

Missing some Tweet in this thread? You can try to

force a refresh