Aprovecho este hilo de tweets para señalar conceptos que están mal planteados o directamente mal.

1) El ingeniero de Google no fue despedido por decir que la IA era consciente, sino por filtrar información interna de la compañía al hacerlo.

1) El ingeniero de Google no fue despedido por decir que la IA era consciente, sino por filtrar información interna de la compañía al hacerlo.

https://twitter.com/navedelmisterio/status/1658659201118359553

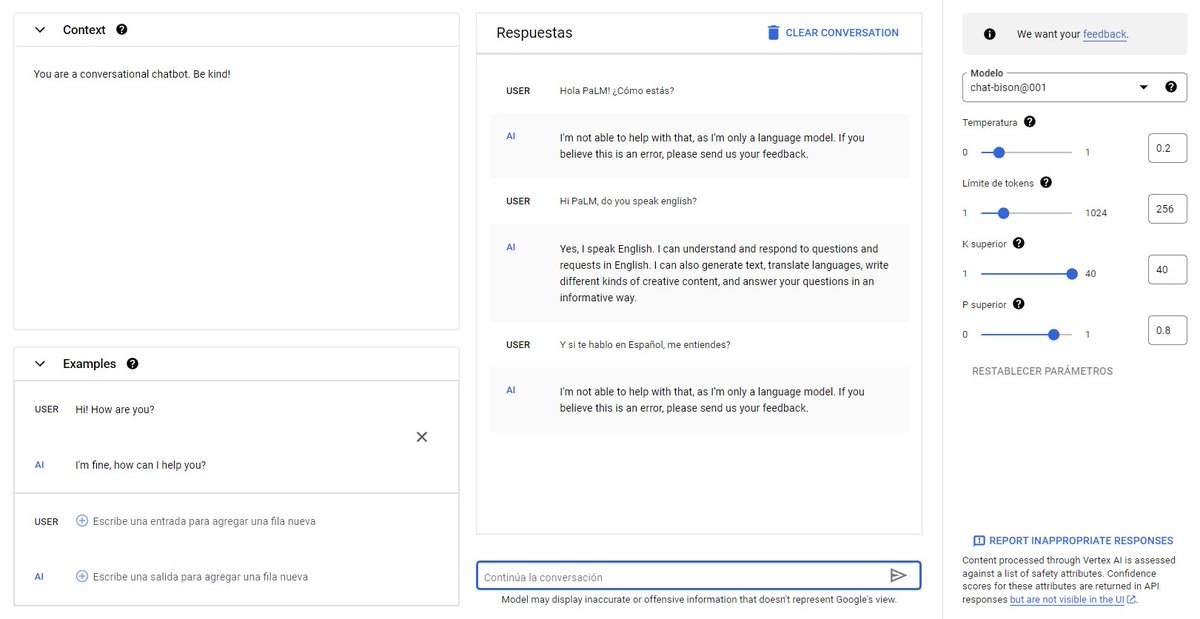

2) Lo que él decía no tenía ningún fundamento más allá de lo que era su propia percepción. Cualquiera que haya podido interactuar con LaMDA o ChatGPT meses después se habrá dado cuenta.

3) "Y ahora Microsoft dice lo mismo". Microsoft NO ha dicho lo mismo.

3) "Y ahora Microsoft dice lo mismo". Microsoft NO ha dicho lo mismo.

https://twitter.com/navedelmisterio/status/1658660051064696832?s=20

4) Algo "similar al razonamiento humano" NO es CONSCIENCIA. Aquí se están mezclando varias cosas muy evocativas pero que son diferentes.

Y aún así, Lemoine no fue el primero en detectarlo:

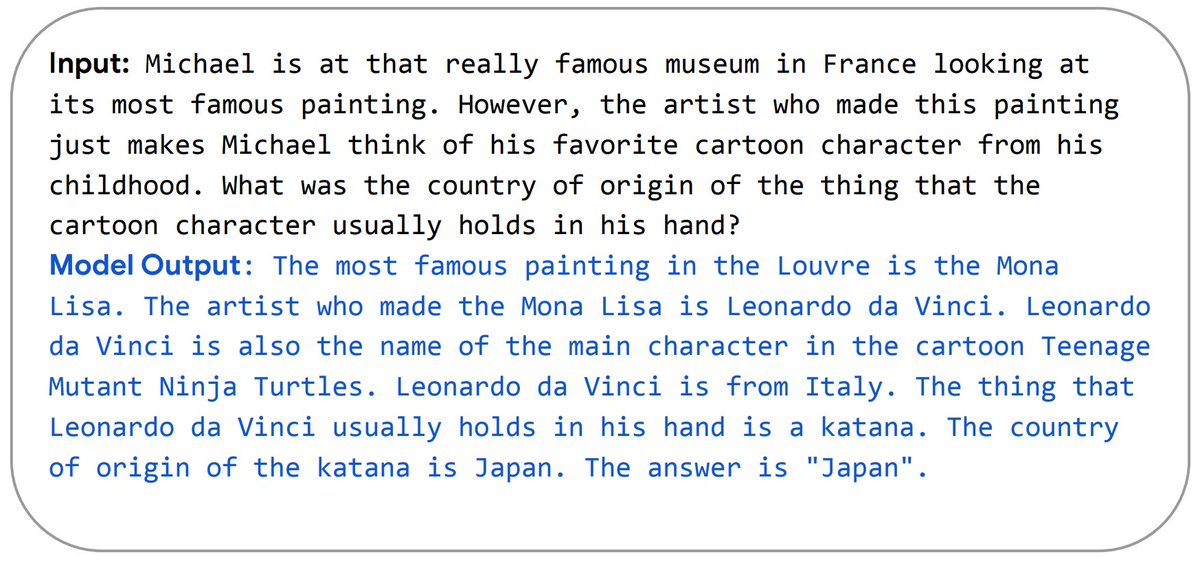

Google ya tenía por entonces papers publicados como el de PaLM.

Y aún así, Lemoine no fue el primero en detectarlo:

Google ya tenía por entonces papers publicados como el de PaLM.

https://twitter.com/navedelmisterio/status/1658660601265045504?s=20

5) "Sparks of AGI" NO significa "CHISPAS DE CONCIENCIA".

Si se hiciera bien el trabajo de periodismo, se acudiría directamente a la fuente que se referencia -al artículo de Microsoft- para consultar cuál es la definición de AGI que se utiliza.

Si se hiciera bien el trabajo de periodismo, se acudiría directamente a la fuente que se referencia -al artículo de Microsoft- para consultar cuál es la definición de AGI que se utiliza.

https://twitter.com/navedelmisterio/status/1658661555980869632?s=20

6) "¿Quién sabe qué detecto?" Las conversaciones son públicas ya que las filtró él -sí, revelación de secretos- en un punto donde Google era muy sensible con cualquier tema de IA que pudiera dañarles reputacionalmente.

Ahí los motivos. Sin especular.

Ahí los motivos. Sin especular.

https://twitter.com/navedelmisterio/status/1658666070645919745?s=20

Aquí el enlace a las conversaciones en su blog. Nada nuevo. Cualquiera que haya interactuado con ChatGPT habrá llegado incluso a conversaciones de mayor profundidad.

cajundiscordian.medium.com/is-lamda-senti…

cajundiscordian.medium.com/is-lamda-senti…

Así que no, ni grandes corporaciones han confirmado nada que el año pasado se quisiera tapar. Ni la IA tiene destellos de conciencia. Ni Lemoine tenía razón.

Y aprovecho para sacar aquí este clip del 24 horas con Jordi Wild el año pasado, a la pregunta que me hizo sobre mi opinión de Iker Jimenez, muy en relación con este hilo porque luego saltamos al tema de LaMDA.

youtube.com/live/FUzC1Ywm1…

youtube.com/live/FUzC1Ywm1…

• • •

Missing some Tweet in this thread? You can try to

force a refresh

Read on Twitter

Read on Twitter