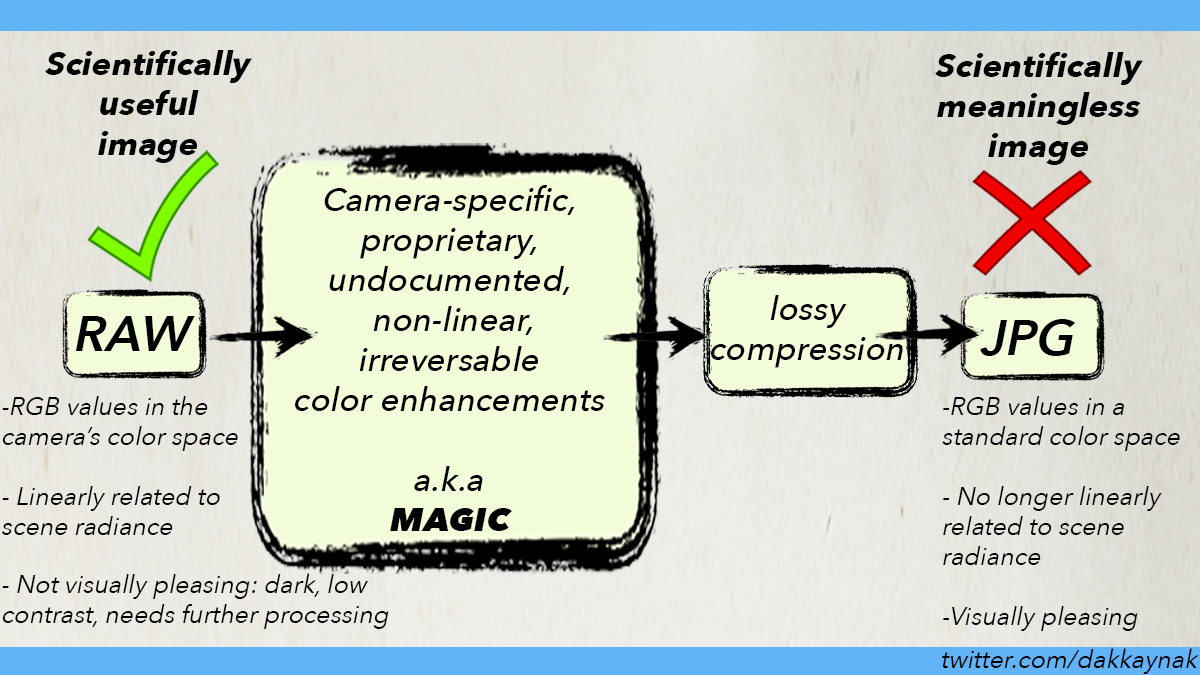

Teşekkür ederim. Fırsattan istifade tekrar belirteyim, yapay zeka değil, fizik temelli bir algoritma. Aradaki fark: yapay zeka olunca onbinlerce fotoğraftan renk öğreniyorsunuz; bir insan "bu yeşil, bu kırmızı, bu sarı" diye o fotoğraflarda belli pikselleri etiketlemiş oluyor +++

https://twitter.com/scuba_turkey/status/1329681307992018946

Yapay zeka o etiketlerden renkler neye benzer öğreniyor; öğrendiklerini yeni fotoğraflara bakıp "hah işte bu kırmızı, ben bunu biliyorum!" diye düzeltiyor. Eğer yapay zekanın karşısına çıkacak her şey çalıştığı yerlerden çıkarsa sorun yok. Ama daha önce görmediği bir renk +++

veya gördüğü bir rengin biraz solmuş hali karşısına çıkarsa çuvallayabiliyor.

Dünya genelinde denizlerdeki su ve dip rengi çok çeşitlilik gösteriyor. Bu çeşitliliği yakalayacak, kalibrasyonu yapılmış sualtı fotoğrafı çekmek aşırı maliyetli ve lojistik olarak imkansıza yakın.

Dünya genelinde denizlerdeki su ve dip rengi çok çeşitlilik gösteriyor. Bu çeşitliliği yakalayacak, kalibrasyonu yapılmış sualtı fotoğrafı çekmek aşırı maliyetli ve lojistik olarak imkansıza yakın.

O yüzden biz şu anda herhangi bir yerde çekilmiş her sualtı fotoğrafını düzeltecek yapay zeka geliştiremiyoruz, çünkü yapay zekayı eğitecek, tüm denizlerin çeşitliliğini içerecek, kalibre edilmiş fotoğraflara sahip değiliz ve yakın gelecekte de olamayacağız.

Ama Sea-thru gibi fizik temelli bir algoritmayla bunu yapabiliyoruz. Çünkü fizik temelli algoritmalar, doğal ışığın doğal su kütlelerinde uğradığı değişimleri bilen bir formül üzerinden çalışıyor. Her piksel için bu formülü uygulayıp, suyun etkisini hesaplayıp,tersine döndürüyor.

Sanırım #seathru çok iyi çalıştığı için "bu olsa olsa yapay zekadır" yakıştırması yapılıyor. Fiziksel temellerin güçlü olduğu bilgisayarla görme problemlerinde yapay zekaya gerek kalmadan da çok iyi sonuçlar almak mümkün. Biz fiziği 2018'de güncellemiştik tinyurl.com/yxrcz52o

Detay merak edenlere🤓 :

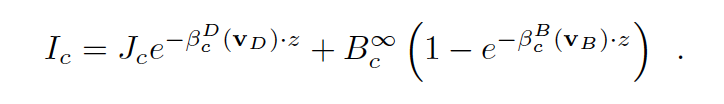

sol 👇: ışığın suda (veya havada) yol alırken uğradığı değişimi içeren fiziksel denklem. Adı da çok havalı: radyatif transfer denklemi.

sağ 👇: radyatif transfer denkleminin fotoğraf makinalarının duyarlı olduğu 3 boyuta (RGB) göre basitleştirilmiş hali

sol 👇: ışığın suda (veya havada) yol alırken uğradığı değişimi içeren fiziksel denklem. Adı da çok havalı: radyatif transfer denklemi.

sağ 👇: radyatif transfer denkleminin fotoğraf makinalarının duyarlı olduğu 3 boyuta (RGB) göre basitleştirilmiş hali

TEDx konuşmamda bu denklemi ve sualtı fotoğraflarının neden mavi ve karanlık olduğunu "sokak lambası" ve "sis" diye günlük hayatımızla ilişkilendirebileceğimiz kavramlarla anlatmaya çalışmıştım.

Gelen yorumlar "Hocam amma heyecanlanmışsınız,sesiniz titriyordu hihi" şeklindeydi 🙄

Gelen yorumlar "Hocam amma heyecanlanmışsınız,sesiniz titriyordu hihi" şeklindeydi 🙄

• • •

Missing some Tweet in this thread? You can try to

force a refresh