Współzałożyciel https://t.co/a9JrgXpEeh - Opensource projekty AI w medycynie

CTO w https://t.co/fpagHocOH3 - Platforma AI dla szpitali

How to get URL link on X (Twitter) App

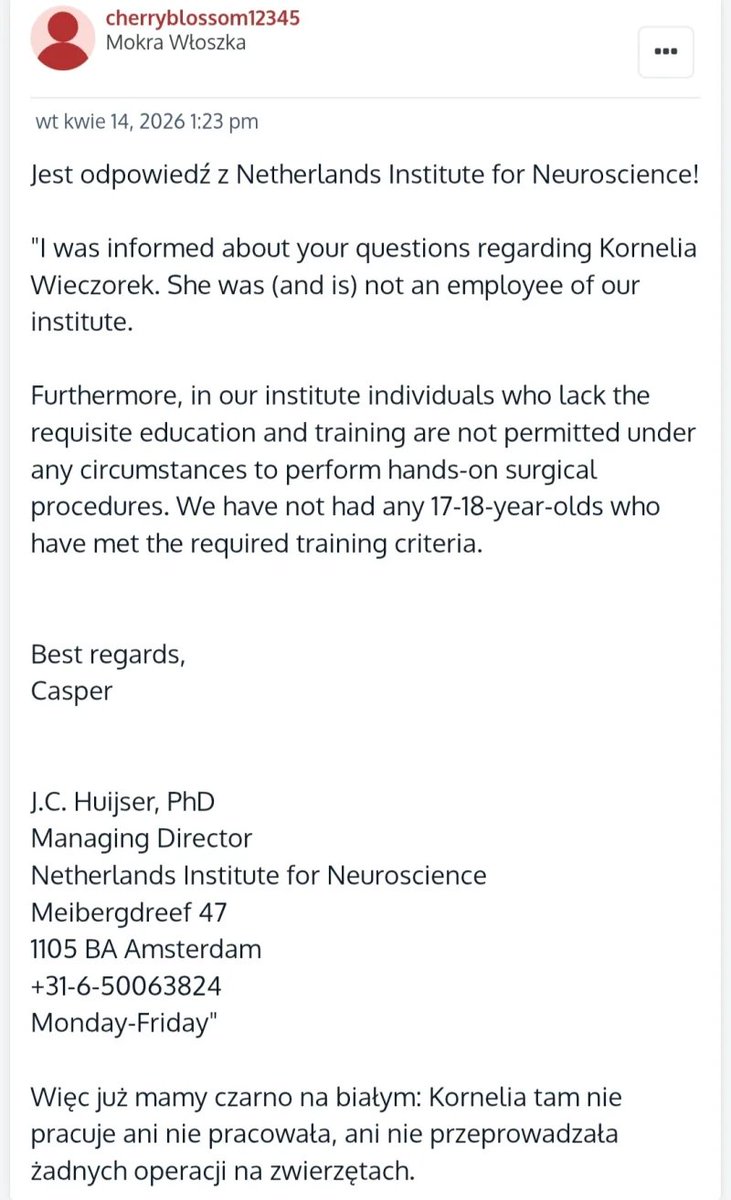

(2/5) Problem w tym, że gdy w kwietniu anonimowi internauci na Reddicie i Wykopie postanowili zweryfikować te „osiągnięcia", posypało się jak domek z kart:

(2/5) Problem w tym, że gdy w kwietniu anonimowi internauci na Reddicie i Wykopie postanowili zweryfikować te „osiągnięcia", posypało się jak domek z kart:

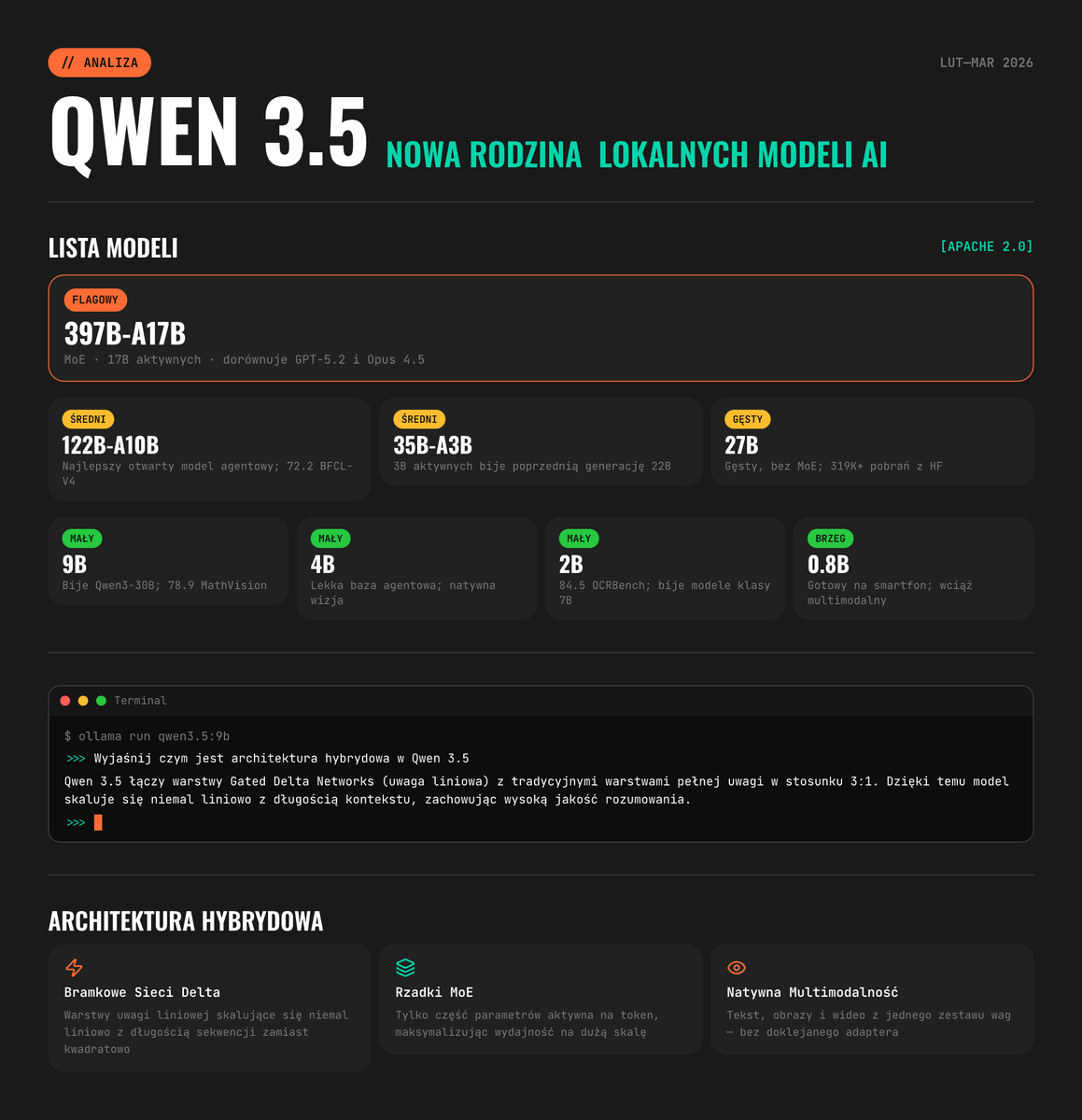

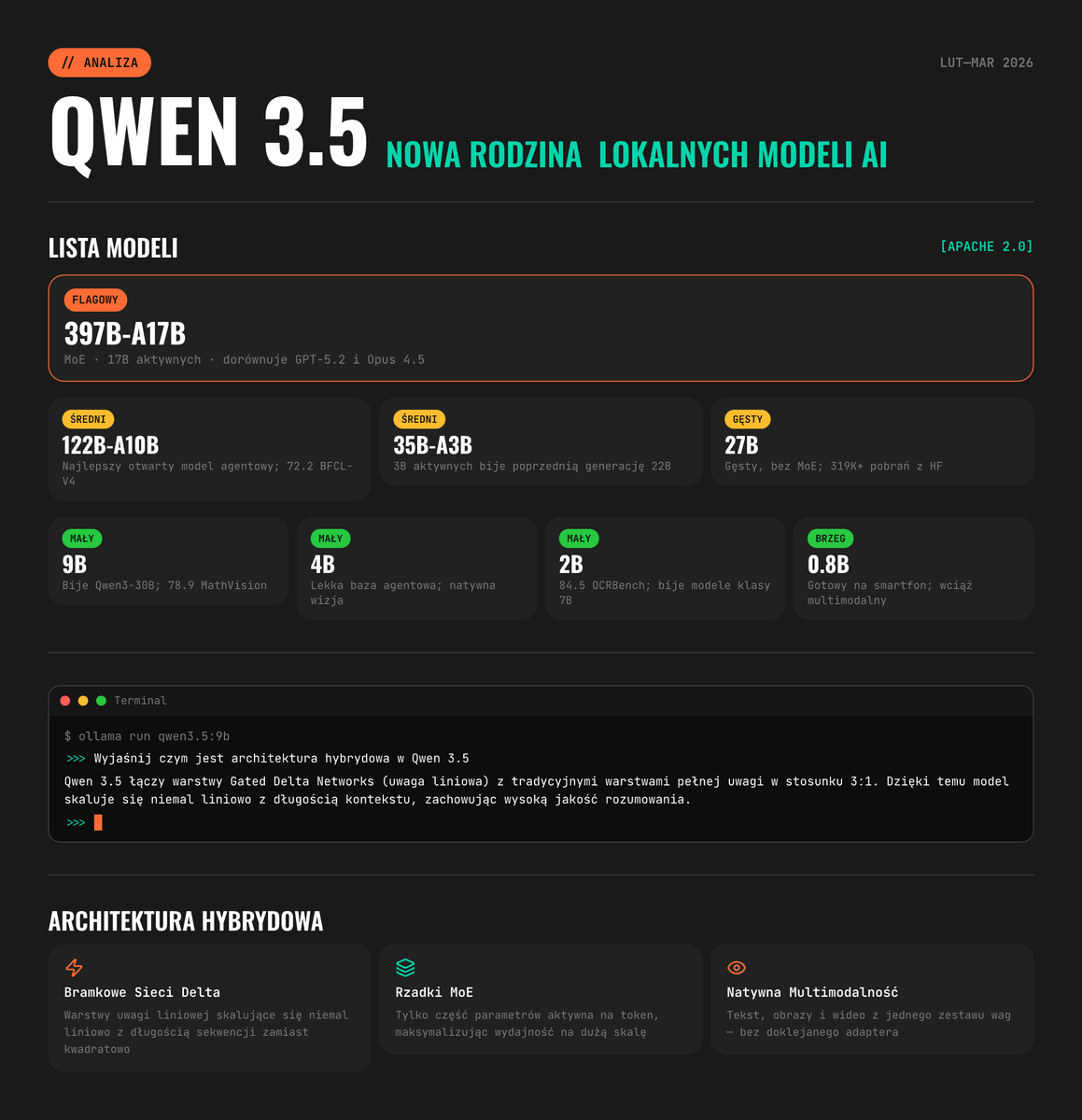

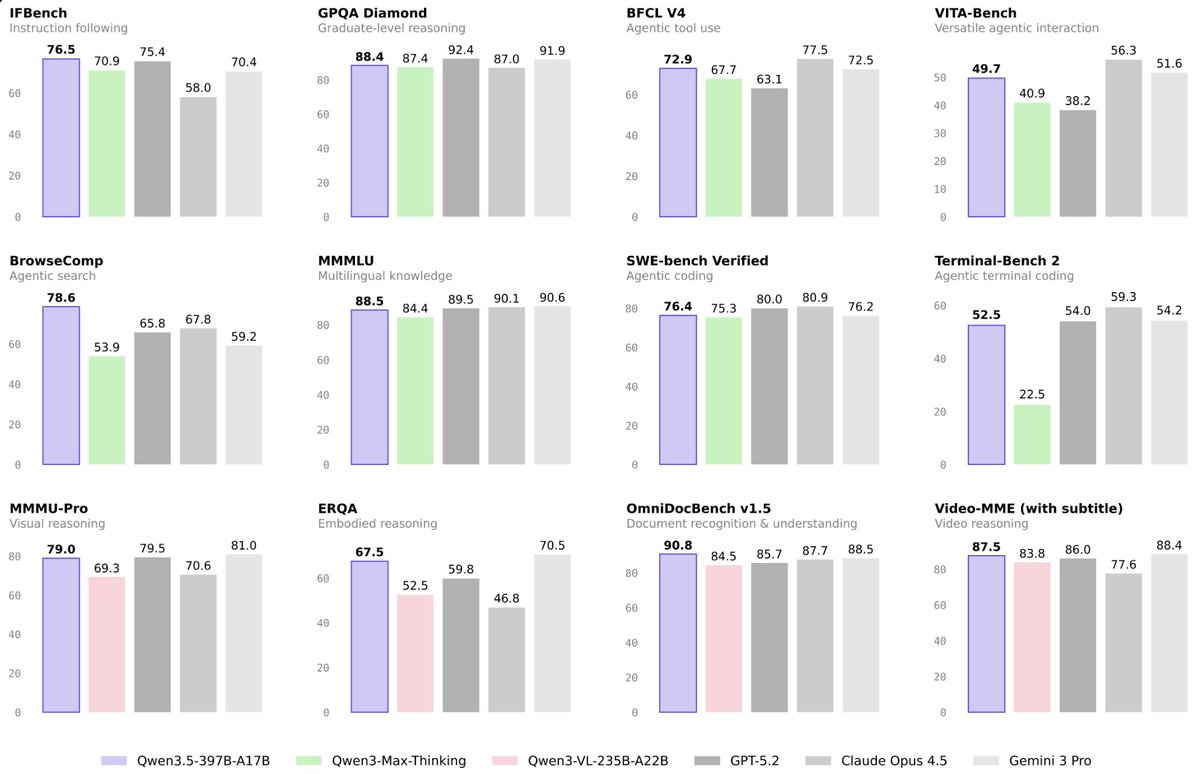

2/ Flagowy model Qwen3.5 - jeden z najlepszych agentów open-source

2/ Flagowy model Qwen3.5 - jeden z najlepszych agentów open-source

(2/8) Co wyróżnia Kimi K2 Thinking?

(2/8) Co wyróżnia Kimi K2 Thinking?

(2/6) Zacznijmy od tego że ChatGPT jest przekonany że istnieje emoji konika morskiego. Dlaczego? Powodów jest kilka,

(2/6) Zacznijmy od tego że ChatGPT jest przekonany że istnieje emoji konika morskiego. Dlaczego? Powodów jest kilka,