Resumen del evento Google #SearchOn de ayer.

En general, muy centrados en AI y comprender las búsquedas, en aprovechar su grafo de productos para ecommerce y en mejorar el aspecto visual de la búsqueda (algunas novedades recuerdan bastante a Pinterest).

Ejemplos en el 🧵

En general, muy centrados en AI y comprender las búsquedas, en aprovechar su grafo de productos para ecommerce y en mejorar el aspecto visual de la búsqueda (algunas novedades recuerdan bastante a Pinterest).

Ejemplos en el 🧵

Ahora podremos mezclar imágenes y palabras al usar Google Lens, gracias a MUM (Multitask Unified Mode).

Ejemplo de Google: apunta a una bici averiada y pregunta ¿cómo arreglo esto? Mi opinión: esto va a tardar en funcionar bien, pero quizá, combinado con la siguiente novedad...

Ejemplo de Google: apunta a una bici averiada y pregunta ¿cómo arreglo esto? Mi opinión: esto va a tardar en funcionar bien, pero quizá, combinado con la siguiente novedad...

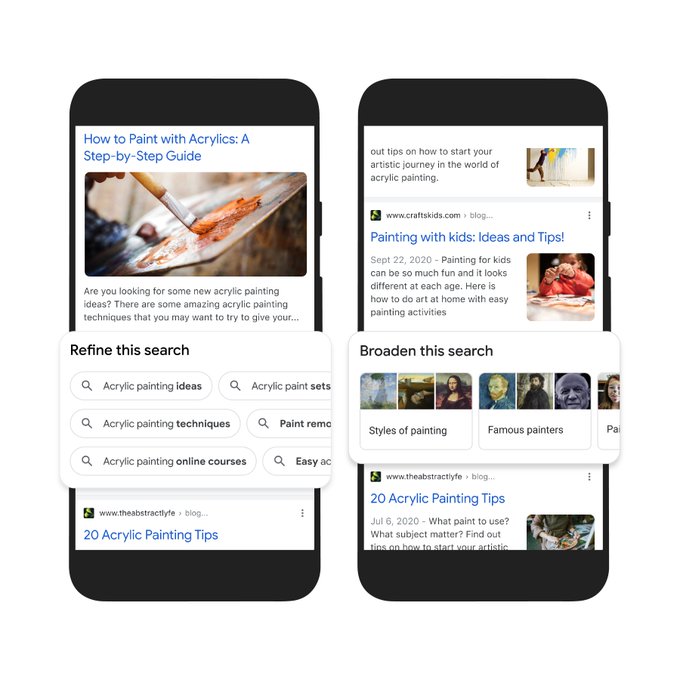

podría ser bastante útil. "Refinar esta búsqueda" y "Ampliar esta búsqueda" serán opciones que podremos aplicar a las búsquedas dentro de unos meses.

IComo hacer zoom o agrandar una imagen, pero con keywords. El modo Refine puede hacer más importantes aún los términos long tail

IComo hacer zoom o agrandar una imagen, pero con keywords. El modo Refine puede hacer más importantes aún los términos long tail

Más cosas de MUM. Será capaz de identificar un tema en un vídeo, incluso aunque este tema no se mencione explícitamente.

Y permitirá extraer subtemas de las búsquedas para enfocarnos en ellos por medio de un nuevo módulo: Things To Know.

Y permitirá extraer subtemas de las búsquedas para enfocarnos en ellos por medio de un nuevo módulo: Things To Know.

Para ciertos temas que Google identifica como "en busca de inspiración", se lanzará un nuevo diseño de SERP, más visual y navegable - como un Discover o Pinterest dentro de Google, en el que según parece todos los resultados orgánicos tendrán imagen grande o preview de vídeo.

Aquí el resumen de Google de sus avances en materia de IA y comprensión de búsquedas: blog.google/products/searc…

#ecommerce. Se estrena el filtro "In Stock", para que los usuarios puedan ver tiendas cerca que tienen un producto concreto a la venta.

Si es como parece, significará que las tiendas con ficha de GMB podrán tener un escaparate tipo ecommerce para su catálogo.

Si es como parece, significará que las tiendas con ficha de GMB podrán tener un escaparate tipo ecommerce para su catálogo.

Las SERPs modo feed visual también llegarán a las búsquedas de ropa, calzado y accesorios. Por ahora sólo para móvil. Yo aún no lo veo, pero por ejemplo la búsqueda "cropped jackets" devolverá este feed visual, directamente en la pestaña de búsqueda, sin ir a imágenes o productos

Google Lens se integrará mejor dentro de la app de Google (empezará por iOS). Dando a un botón, haremos que todas las imágenes de una página se hagan "buscables" mediante Lens.

Lens llegará también a Chrome en desktop. Podrás hacer clic en una imagen de la página y ver resultados de búsqueda relacionados, en esa misma pestaña. Esto imagino que hará bastante daño a Pinterest.

Resumen de Google de sus novedades para ecommerce: blog.google/products/shopp…

Resumen de Google de sus novedades para ecommerce: blog.google/products/shopp…

• • •

Missing some Tweet in this thread? You can try to

force a refresh