#Desinformation - ich habe neulich einen Vortrag dazu gehalten. Jetzt als (sehr langer)🧵.

Hoch relevant, denn in der kommenden Energiekrise könnte Desinformation auftreten, die Querdenker wie ein Kindergarten wirken lässt. Los geht's. 1/42

Hoch relevant, denn in der kommenden Energiekrise könnte Desinformation auftreten, die Querdenker wie ein Kindergarten wirken lässt. Los geht's. 1/42

Nach dem Thread wissen wir, dass

- Desinformation auch ohne Absicht auftritt

- psychologische Impfung hilft

- und wie False Balance schadet

- Gamification helfen kann 2/42

- Desinformation auch ohne Absicht auftritt

- psychologische Impfung hilft

- und wie False Balance schadet

- Gamification helfen kann 2/42

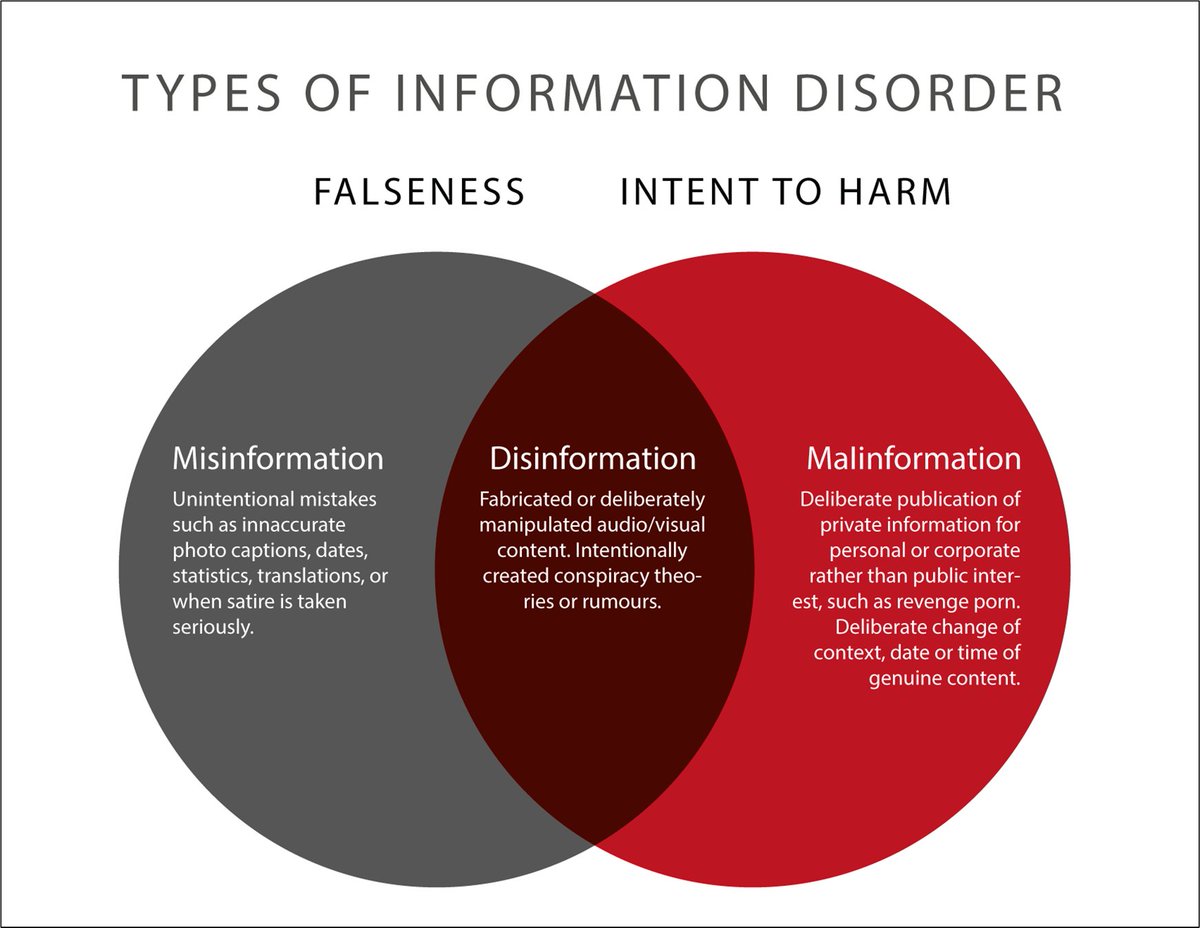

Zunächst: Im Rahmen dieses Threads werden die Begriff Misinformation, Desinformation und Malinformation synonym behandelt. Das sind sie eigentlich nicht, aber dies hier ist auch keine Hausarbeit. ;) 3/42

Zunächst: Menschliche Faktoren.

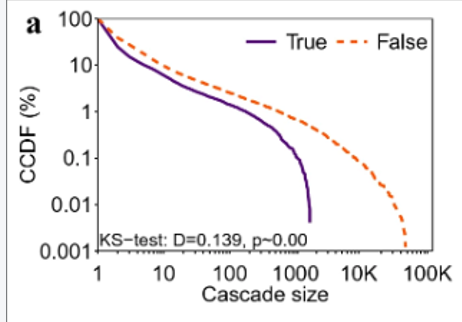

1. Falsche Information verbreitet sich bis zu 6x schneller und um Größenordnungen(!) weiter.

(Pröllochs, et al (2021). Emotions explain differences in the diffusion of true vs. false social media rumors) doi.org/10.1038/s41598… 4/42

1. Falsche Information verbreitet sich bis zu 6x schneller und um Größenordnungen(!) weiter.

(Pröllochs, et al (2021). Emotions explain differences in the diffusion of true vs. false social media rumors) doi.org/10.1038/s41598… 4/42

Das heißt auch: Faktenchecks verbreiten sich langsamer und weitaus weniger weit.

„False news spread farther, faster, deeper, and more broadly“ (Roy Vosoughi, 2018)

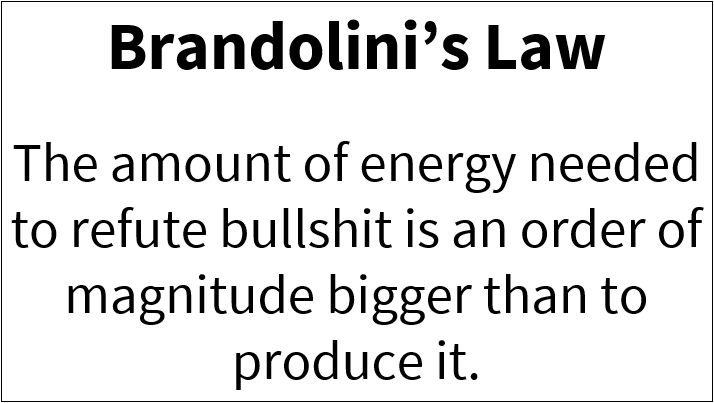

Das passt zu Brandolini's Law. 5/42

„False news spread farther, faster, deeper, and more broadly“ (Roy Vosoughi, 2018)

Das passt zu Brandolini's Law. 5/42

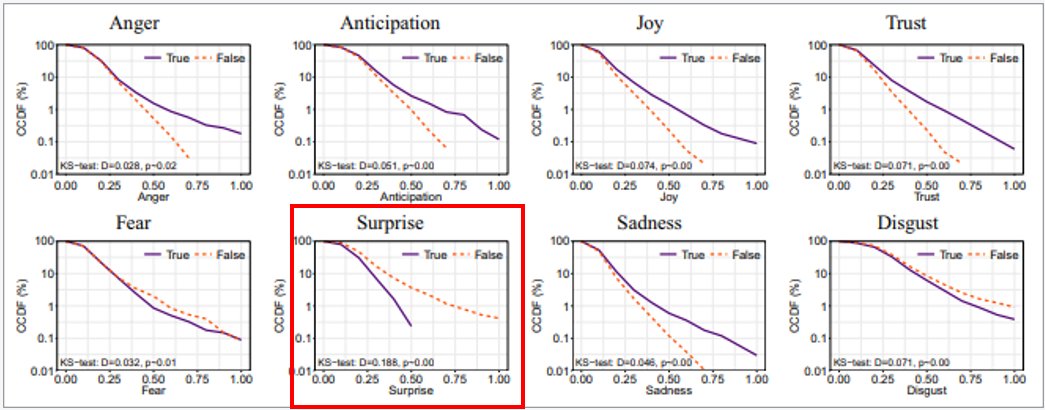

Nicht jede "Trägeremotion" erzeugt dabei die gleiche Viralität. Nach Nicolas Pröllochs geht die Viralität insbesondere auf Überraschendes zurück. Macht Sinn: Lügen haben es viel leichter, zu überraschen, sie müssen ja nicht stimmen. 6/42

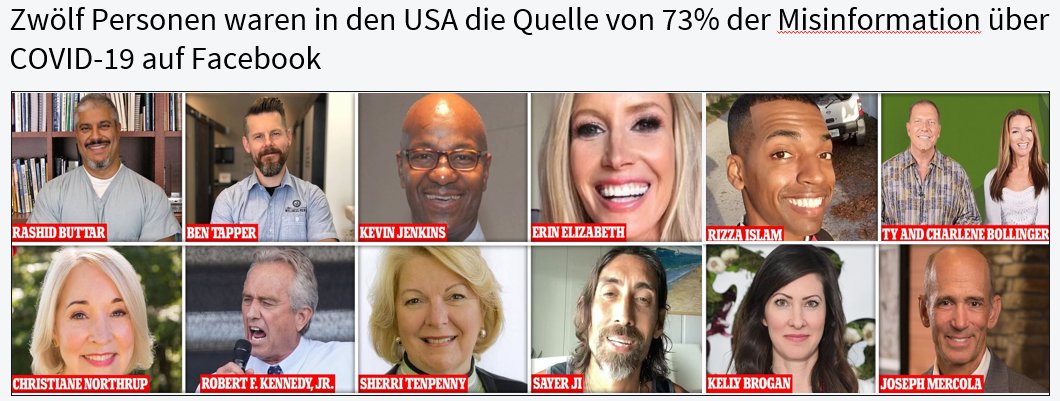

2. Nur wenige Personen sind Urheber.

Zumindest in den USA und beim Thema Covid-19 identifizierte @kakape 12 Personen, die für 73% der Misinformation verantwortlich waren. 7/42

Zumindest in den USA und beim Thema Covid-19 identifizierte @kakape 12 Personen, die für 73% der Misinformation verantwortlich waren. 7/42

3. Hass ist online und offline gleich

@M_B_Petersen fand heraus, dass die Menschen offline und online ungefähr gleich hasserfüllt sind.

(2021, doi.org/10.1017/S00030…) 8/42

@M_B_Petersen fand heraus, dass die Menschen offline und online ungefähr gleich hasserfüllt sind.

(2021, doi.org/10.1017/S00030…) 8/42

4. Wer Fehlinformationen teilt, mag die andere Seite nicht.

Wieder @M_B_Petersen: Wer politische Fehlinformation teilt, ist nicht ignoranter als der Durchschnitt und teilen ansonsten auch richtige, aber voreingenommene Informationen. 9/42

Wieder @M_B_Petersen: Wer politische Fehlinformation teilt, ist nicht ignoranter als der Durchschnitt und teilen ansonsten auch richtige, aber voreingenommene Informationen. 9/42

5. Daraus geht mE hervor: Es gibt of keinen sinistren Mastermind oder Financier. Desinformation kann auch ohne planvolle Urheber entstehen und verbreitet sich in einer eigenen Dynamik.

Es gilt vermutlich Hanlon's Razor. 10/42

Es gilt vermutlich Hanlon's Razor. 10/42

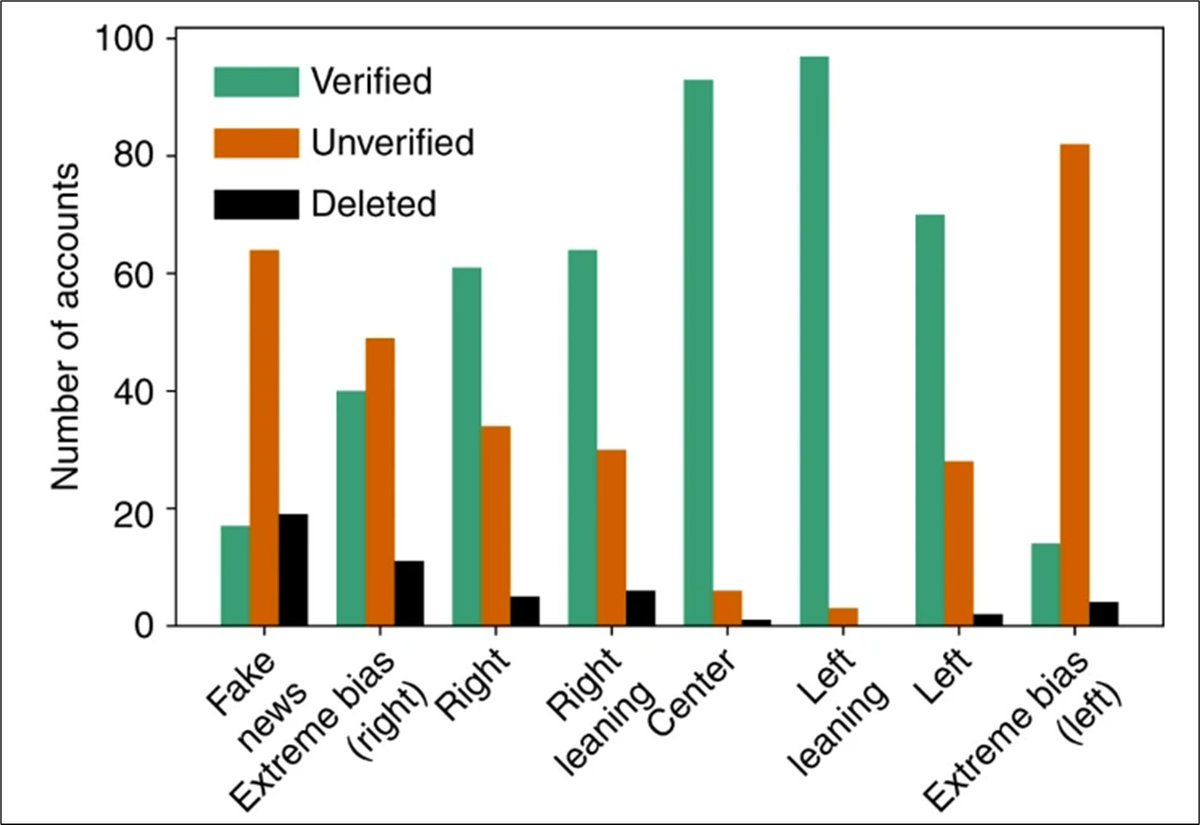

6. Je extremer die Accounts sich positionieren, desto weniger oft sind sie verified. (Bovet, A., & Makse, H. A. (2019). Influence of fake news in Twitter during the 2016 US presidential election. Nature Communications, 10(1), 7. doi.org/10.1038/s41467…) 11/42

7. Spannend für mich: Bots spielen offenbar keine messbare Rolle beim Verbreiten von Desinformation. Vielmehr ist es so, dass sich alle Seiten gegenseitig vorwerfen, in Wirklichkeit Bots zu sein.

Vosoughi, S., Roy, D., & Aral, S. (2018) 13/42

Vosoughi, S., Roy, D., & Aral, S. (2018) 13/42

8. Rabbit Holes

Hier wird's spannend: Da Begriffe bei Verschwörungstheorien oft neu sind, gibt eine Onlinesuche dann auch nur entsprechende Seiten aus. Das "Informier-Dich-Selbst-Rabbit Hole". (Kleinen-von Königslöw @kkvk7, von Nordheim, 2021, S. 23) 14/42

Hier wird's spannend: Da Begriffe bei Verschwörungstheorien oft neu sind, gibt eine Onlinesuche dann auch nur entsprechende Seiten aus. Das "Informier-Dich-Selbst-Rabbit Hole". (Kleinen-von Königslöw @kkvk7, von Nordheim, 2021, S. 23) 14/42

Die daraus folgende „Erfahrung kollektiver Identität normalisiert und legitimiert die eigene Überzeugung" (zitiere wieder @kkvk7) heißt quasi: Wenn Du zu lange in das Kaninchenloch starrst, starrt das Kaninchenloch zurück. 15/42

9. Ebenfalls @kkvk7: Neue Inhalte entwickeln sich dann oft durch eine Art kollaboratives Verschwörungsspiel in Telegramgruppen und ähnliche. Gewissermaßen ein MMPORG, Massive Multiplayer Online Roleplay Game. 16/42

Zusammengefasst bis hier:

- Falsch = 6x schneller

- Wenige Urheber*innen

- Teilnehmer*innen an Desinformation haben oft negativere Grundgefühle

- Menschen, nicht Bots sind verantwortlich

- Verschwörungstheorien sind MMPORGs

- Rabbit Holes 17/42

- Falsch = 6x schneller

- Wenige Urheber*innen

- Teilnehmer*innen an Desinformation haben oft negativere Grundgefühle

- Menschen, nicht Bots sind verantwortlich

- Verschwörungstheorien sind MMPORGs

- Rabbit Holes 17/42

Nach den menschlichen Faktoren nun die Umweltfaktoren.

1. „Plattformbetreiber*innen sind radikal indifferent gegenüber der Qualität der Inhalte“ (@shoshanazuboff, 2018). Die Ursache sind wirtschaftliche Interessen, die Folge sind Qualitätsdefizite. 18/42

1. „Plattformbetreiber*innen sind radikal indifferent gegenüber der Qualität der Inhalte“ (@shoshanazuboff, 2018). Die Ursache sind wirtschaftliche Interessen, die Folge sind Qualitätsdefizite. 18/42

2. Das passiert weniger, wenn die Diskursqualität stimmt. Asynchron, nicht anonym, moderiert und thematisch fokussiert.

Neuberger, C. @alttaler (2022). Digitale Öffentlichkeit und liberale Demokratie. 19/42

Neuberger, C. @alttaler (2022). Digitale Öffentlichkeit und liberale Demokratie. 19/42

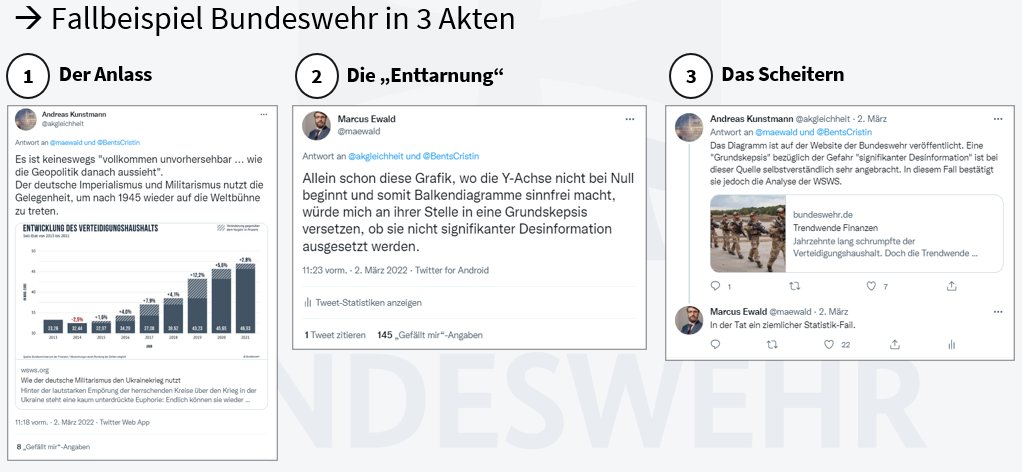

3. Grundprobleme gibt es, wenn die eigentlich vertrauenswürdigen Quellen selbst unsauber arbeiten. Dann fällt ein leichtfüßiges enttarnen viel schwerer. 20/42

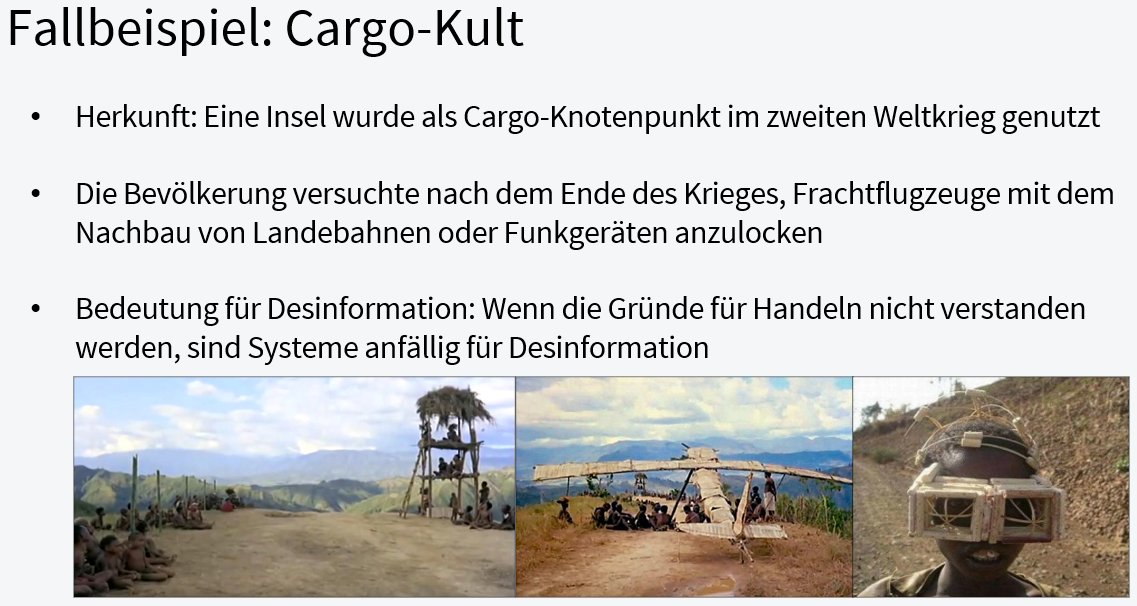

4. Oft sind Cargo-Kulte ein Problem: Wenn Menschen nicht begreifen, warum etwas getan wird, sind sie viel anfälliger für alternative Erklärungen der Realität. Das betrifft sowohl das Innenleben von Unternehmen als auch Gesellschaften.

de.wikipedia.org/wiki/Cargo-Kult 21/42

de.wikipedia.org/wiki/Cargo-Kult 21/42

5. Auch das Festhalten an Zuständigkeiten kann anfällig machen: In Portugal konnte mit dem dezidiert unpolitischen Admiral e Melo den dortigen Querdenkern der Wind aus den Segeln genommen werden.

https://twitter.com/maewald/status/1444191477345800194?s=20&t=V3DCEIk0qWHCF4mLMQ0nsw22/42

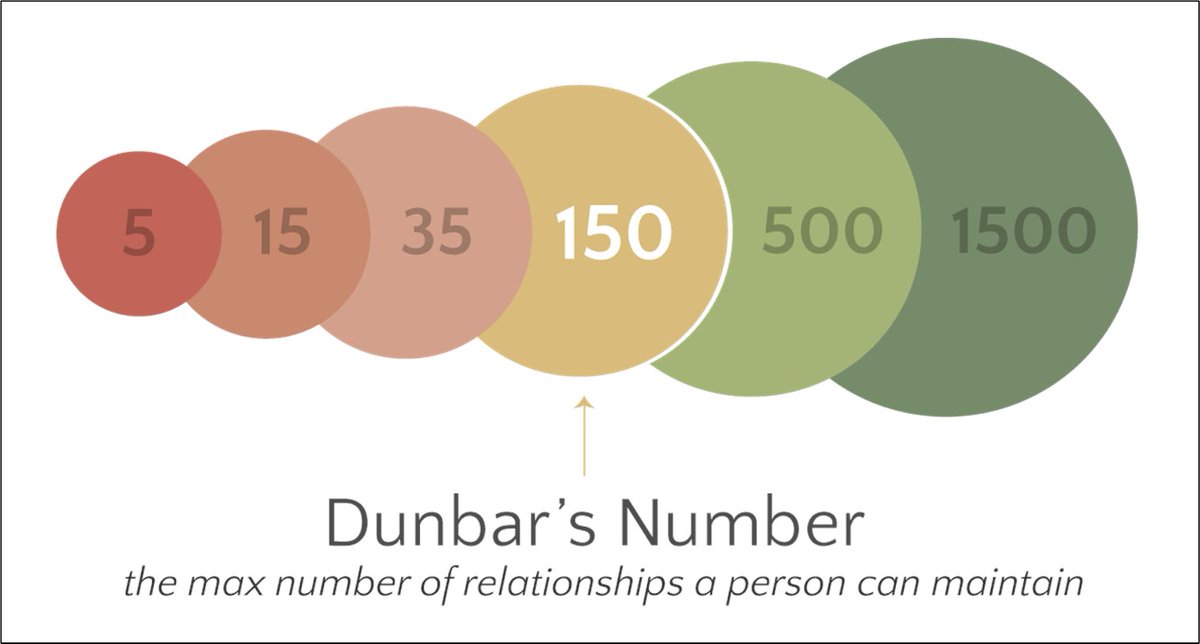

6. Ich vermute: Es gibt eine kritische Schwelle von der Anzahl von Personen in jedem System, aber der die Mechanismen für Desinformation greifen. Wie groß? Keine Ahnung, aber größer als Dunbar's Number dürfte es sein. 23/42

Nun gut - aber was hilft denn und was können wir unternehmen?

1. Ich glaube: Ich glaube insbesondere vor großen Veränderungen sollten Personen präventiv aus Desinformation vorbereitet werden. Beispielsweise jetzt, vor der nahenden Energiekrise. 24/42

1. Ich glaube: Ich glaube insbesondere vor großen Veränderungen sollten Personen präventiv aus Desinformation vorbereitet werden. Beispielsweise jetzt, vor der nahenden Energiekrise. 24/42

2. Wie sehr hilft so ein Prebunking? Absolute Leseempfehlung: Dieses brandneue Paper.

https://twitter.com/roozenbot/status/1526913431454240769?s=20&t=CBrtbDemCxWqdN5WMN-Zxg25/42

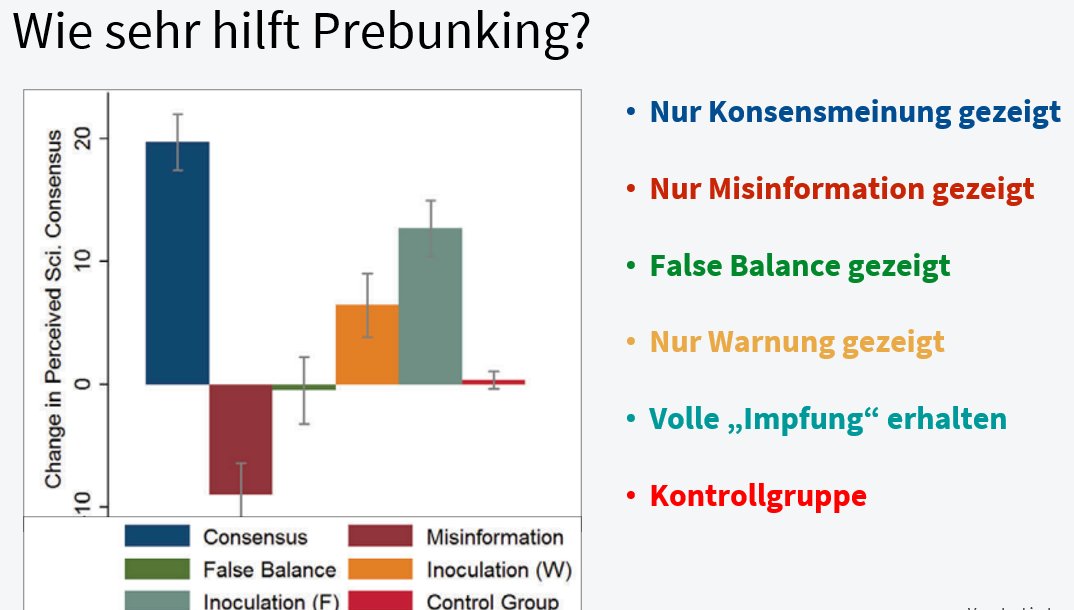

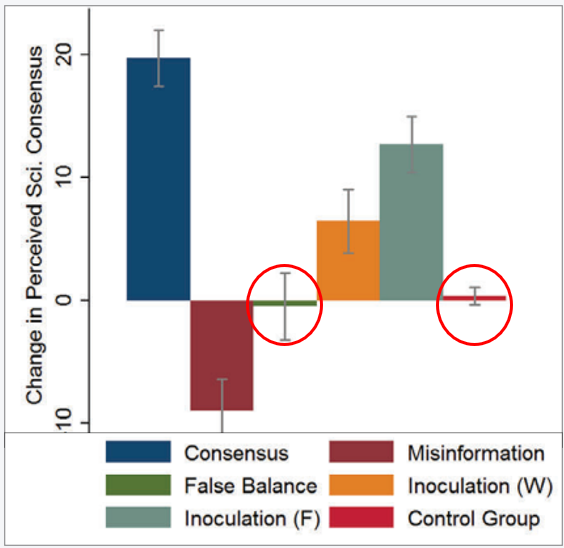

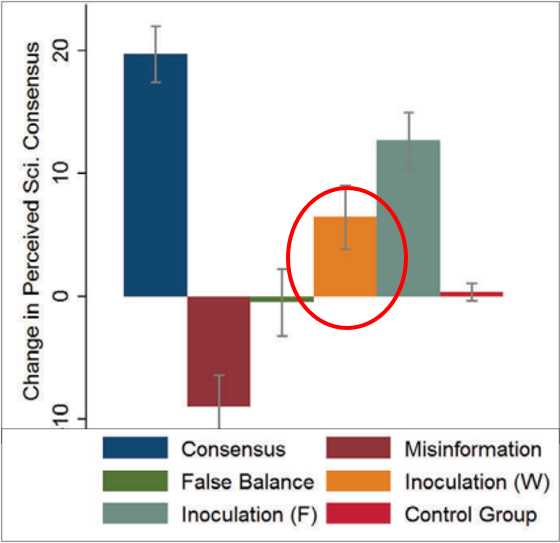

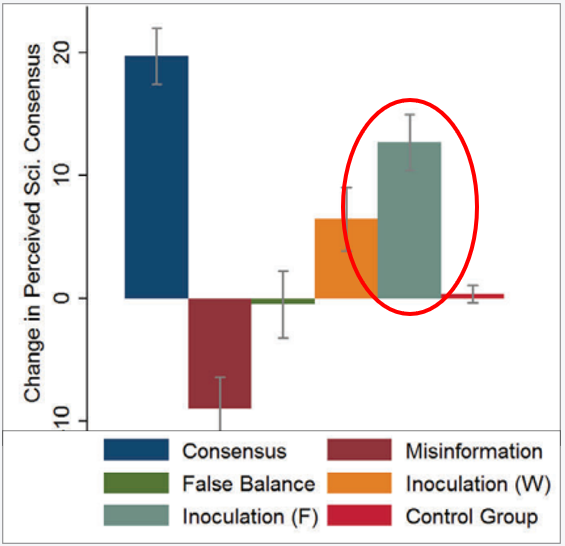

Erstmal die Grafik wirken lassen. Wie sehr möchten Leute ihre Meinung ändern, wenn sie bestimmte Informationen erhalten? Inoculation (W) sind "Flags", (F) sind Argumente. 26/42

Hier sehen wir, dass die False Balance-Gruppe zeigt ähnliche Haltung wie die nicht informierte Kontrollgruppe. False Balance-Gruppe zeigt ähnliche Haltung wie die nicht informierte Kontrollgruppe 27/42

Hier wird deutlich: Plattformen sollten besser darin werden, unzuverlässige Quellen und irreführende oder faktisch falsche Inhalte zu kennzeichnen oder sogar zu löschen. 28/42

Am wirksamsten ist die volle "Inoculation" - Vorwarnung und präventive Widerlegung des (erwarteten) Desinformation. 29/42

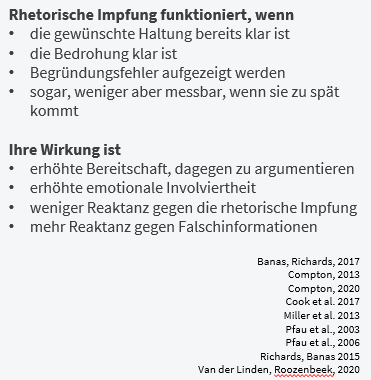

Hier eine kurze Sammlung, was so eine rhetorische Impfung können muss: Bedrohung muss klar sein, und wer geimpft wurde, ärgert sich darüber, wenn er oder sie desinformiert werden soll. 30/42

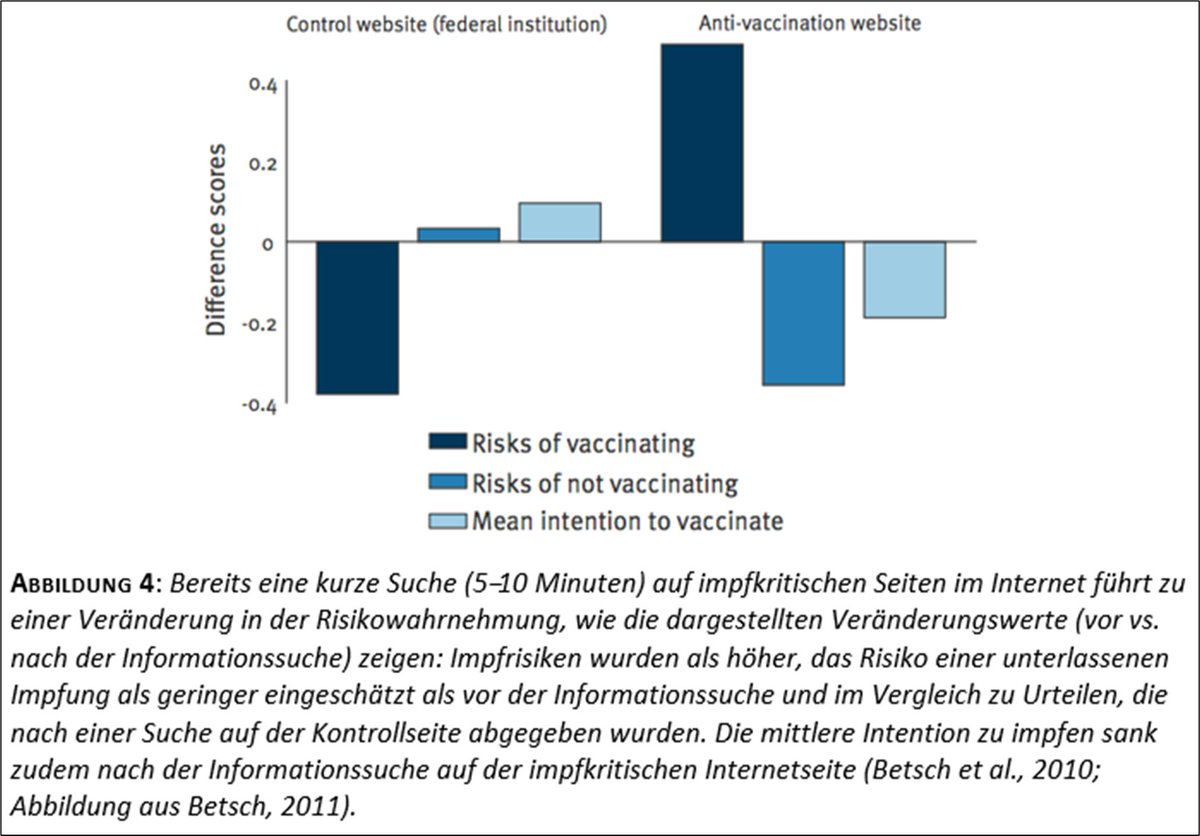

3. Natürlich trifft das auch auf Impfskepsis zu: Hier einige Erkenntnisse von @CorneliaBetsch. Wer sich auf impfskeptischen Seiten informiert, ist danach impfskeptisch. 31/42

4. Die Folge für mich daraus: Multiplikatoren müssen massiv vorab prebunked werden und dann in Stammtischen, Kegelklubs, Kantinen und Online wirken. 32/42

5. Ich würde die These aufstellen, dass es für jede soziale Gruppe eine Prozentzahl Mitglieder gibt, ab der die gesamte Gruppe besser vor Desinformation geschützt ist. 33/42

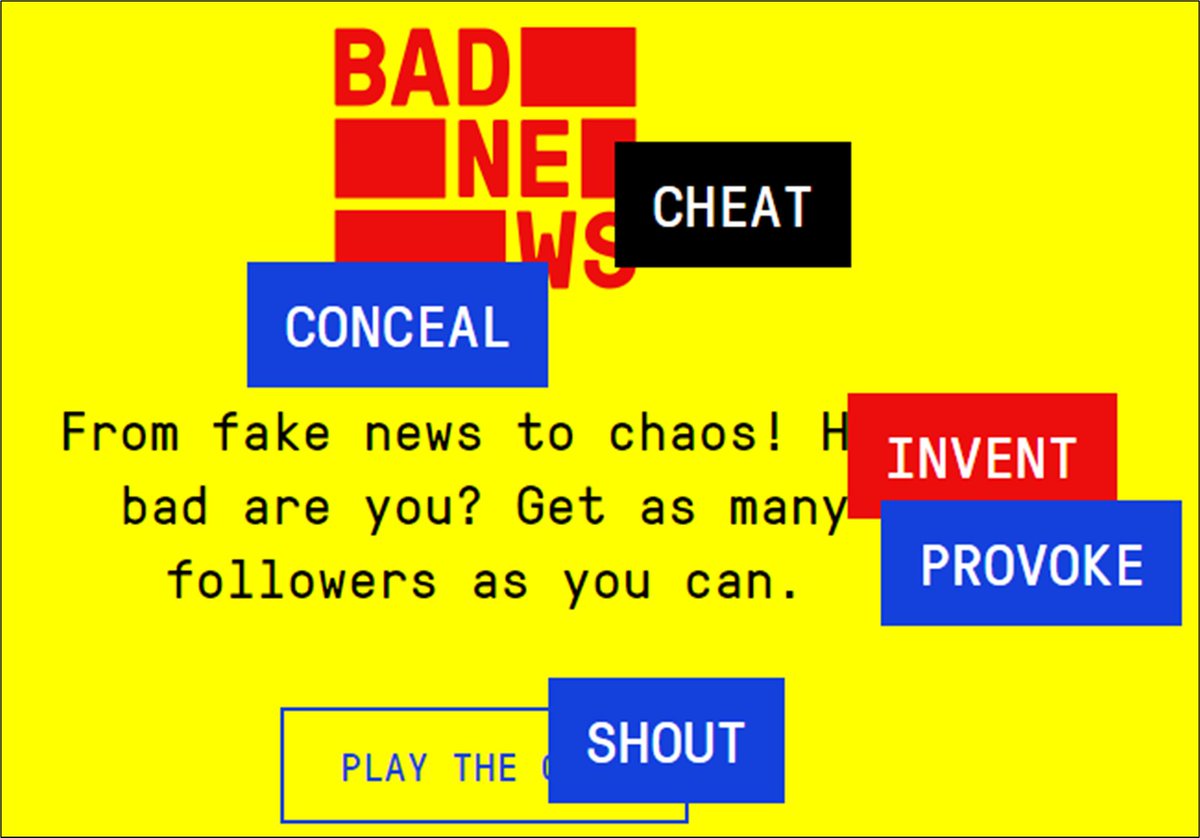

6. Gamification hilft: Dieses Spiel beispielsweise lässt euch in die Rolle der Desinformierer schlüpfen. Dadurch erkennt ihr dann leichter die Strategien und seid resilienter.

getbadnews.com 34/42

getbadnews.com 34/42

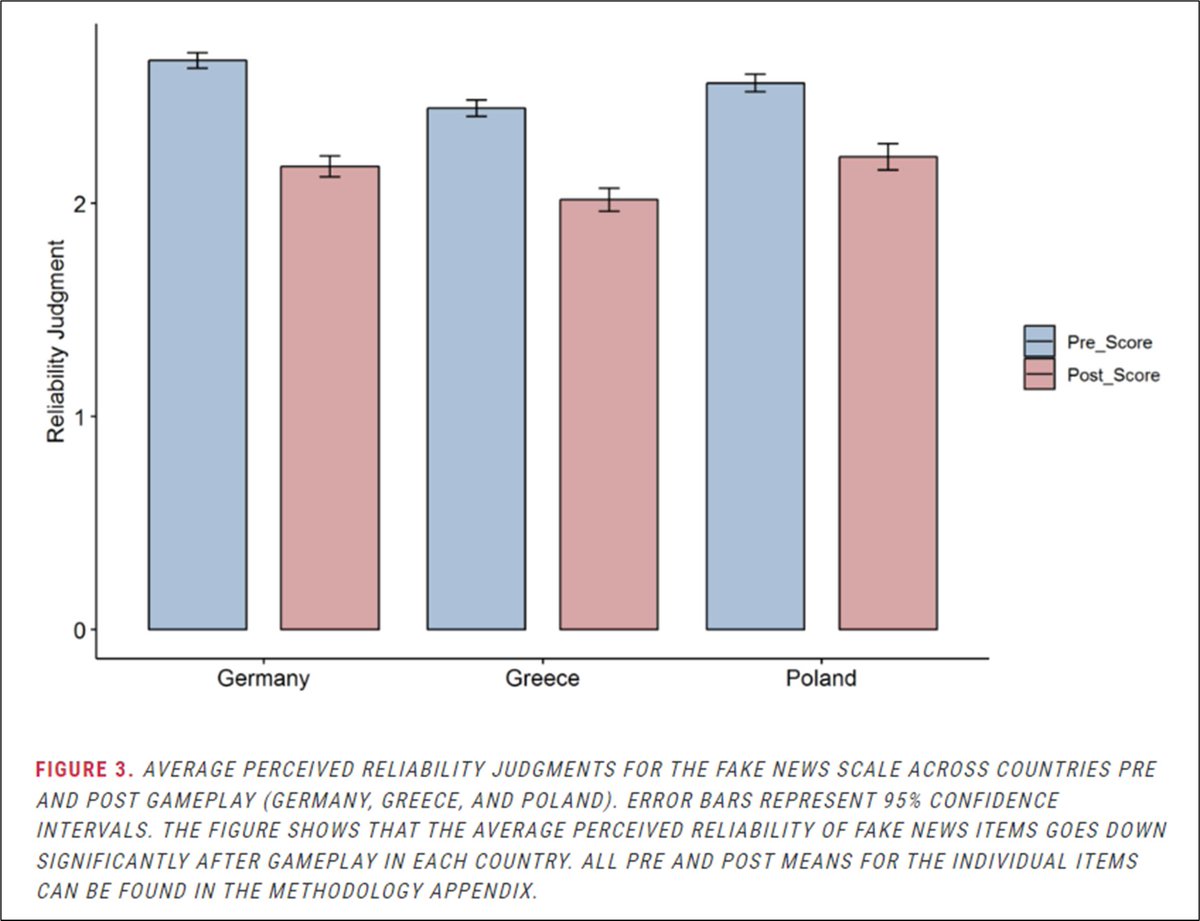

Der Effekt ist nicht riesig, aber messbar: Die Glaubwürdigkeit von Fake News sank in Deutschland, Griechenland und Polen nach dem Spielen signifikant. (@roozenbot) 35/42

Das Ganze gab es in Großbritannien auch gegen Covid-19-Desinformation. Das Go Viral Game.

goviralgame.com 36/42

goviralgame.com 36/42

Und was können wir machen?

1. Privat

Sich selbst zum Teil der kritischen Masse machen, Desinformationsspiele spielen und empfehlen und in eigenen Organisationen Workshops und Maßnahmen einfordern. Jeder Kopf zählt. 37/42

1. Privat

Sich selbst zum Teil der kritischen Masse machen, Desinformationsspiele spielen und empfehlen und in eigenen Organisationen Workshops und Maßnahmen einfordern. Jeder Kopf zählt. 37/42

2. Unternehmen

- Entscheidungsprozesse transparent begründen

- Hohen internen Standard für Darstellung von Daten schaffen

- Vor Veränderungen und Krisen Multiplikatoren impfen

- Regelmäßige Audits der Gerüchteküche 38/42

- Entscheidungsprozesse transparent begründen

- Hohen internen Standard für Darstellung von Daten schaffen

- Vor Veränderungen und Krisen Multiplikatoren impfen

- Regelmäßige Audits der Gerüchteküche 38/42

3. Politik

- Anti-Desinformations-Programme für für alle Beamtinnen und Beamte

- An Schulen

- "Tag der Desinformation": Bundesweit sensibilisieren und Multiplikatoren anwerben

- Plattformen um stärkere Verbreitung von Prebunking bitten 39/42

- Anti-Desinformations-Programme für für alle Beamtinnen und Beamte

- An Schulen

- "Tag der Desinformation": Bundesweit sensibilisieren und Multiplikatoren anwerben

- Plattformen um stärkere Verbreitung von Prebunking bitten 39/42

4. Medien

- Falsches auch klar kennzeichen

- False Balance minimieren

- True Balancing: Sowohl links *und* rechts andere Meinungen präsentieren

- Prebunking Raum geben 40/42

- Falsches auch klar kennzeichen

- False Balance minimieren

- True Balancing: Sowohl links *und* rechts andere Meinungen präsentieren

- Prebunking Raum geben 40/42

5. Klar werden: Die kommende Krise wird Desinformation hervorbringen, gegen die die Querdenker wie ein Kindergarten wirken. Hier muss etwas getan werden. Fordert es ein. 41/42

So, das wars. Die hübschen Bilder wurden übrigens mit @midjourney generiert. Danke auch dafür :)

Ende des 🧵 42/42

Ende des 🧵 42/42

PS: Das hier ist ebenfalls lesenswert.

https://twitter.com/Thomas_Wuest/status/1534585514975707137?t=ARVEGfg-Ew5WoELQQnt9Xg&s=19

PS2: mehr zum Spielen

https://twitter.com/MaineC/status/1541821123607814146?t=ARVEGfg-Ew5WoELQQnt9Xg&s=19

PS3: hier noch etwas mehr Inhalt von @roozenbot

https://twitter.com/roozenbot/status/1526913439284838400?t=_vIfp05ktcM_OkFQKvNhUg&s=19

PS4:

1. Wenn ihr Beispiele aus anderen Ländern kennt, wie #Desinformation begegnet wird, gerne teilen. (Finnland?)

2. Wenn ihr noch andere Strategien oder wissenschaftliche Erkenntnisse habt, auch gerne her damit.

1. Wenn ihr Beispiele aus anderen Ländern kennt, wie #Desinformation begegnet wird, gerne teilen. (Finnland?)

2. Wenn ihr noch andere Strategien oder wissenschaftliche Erkenntnisse habt, auch gerne her damit.

Hier könnt ihr das Desinformations-Spiel auf Deutsch spielen.

Von der Falschmeldung zum Chaos! Wie böse bist du? Dein Ziel: Follower gewinnen.

Auch was für alle Lehrerinnen und Lehrer dabei #twlz

47/

getbadnews.de/#intro

Von der Falschmeldung zum Chaos! Wie böse bist du? Dein Ziel: Follower gewinnen.

Auch was für alle Lehrerinnen und Lehrer dabei #twlz

47/

getbadnews.de/#intro

Siehe auch die Hinweise von @antonioguterres zum heutigen Social Media Day.

49/

49/

https://twitter.com/antonioguterres/status/1542338382709133313?t=fTM5zdZBN8ZJAW2gnHht4w&s=19

Wichtig: Wenn ihr den Thread zu #Desinformation lest und meint, das betrifft nur die "Anderen" - vermutlich seid ihr selbst auch in einigen Themen betroffen.

Hier ist eine gute Liste, die Mythen mit politischer Überzeugung korreliert.

/50

Hier ist eine gute Liste, die Mythen mit politischer Überzeugung korreliert.

/50

https://twitter.com/robkhenderson/status/1550867862818115586?t=D9dlN-VzUHxazZTeOMpPhA&s=19

Verschwörungstheorien sind in der Politik leider erfolgreiche politische Meme - sie bringen stabil mehr Erfolg. Eine Versuchung für alle.

Hier stellt die Autorin @A_Marie_sci ihres und @M_B_Petersen's Paper in einem detaillierten Thread vor.

/51

Hier stellt die Autorin @A_Marie_sci ihres und @M_B_Petersen's Paper in einem detaillierten Thread vor.

/51

https://twitter.com/A_Marie_sci/status/1556639126748909568?t=wCJS2IYT3JLf4tAl5VyDCg&s=19

Hier noch ein gutes Chart zu den Methoden der Wissenschaftsdiskreditierung PLURV:

- Pseudoexperten

- Logische Trugschlüsse

- Unerfüllbare Erwartungen

- Rosinenpickerei

- Verschwörungsmythen

/52

- Pseudoexperten

- Logische Trugschlüsse

- Unerfüllbare Erwartungen

- Rosinenpickerei

- Verschwörungsmythen

/52

https://twitter.com/CScharun/status/1576453173425762305?t=kL6FoF6UbZGGSuOxpF5yYw&s=19

Die Techniken der Wissenschaftsleugnung hier nochmal als praktische Mindmap.

Pseudoexperten

Logische Trugschlüsse

Unerfüllbare Erwartungen

Rosinenpickerei

Verschwörungsmythen

53/

skepticalscience.com/translationblo…

Pseudoexperten

Logische Trugschlüsse

Unerfüllbare Erwartungen

Rosinenpickerei

Verschwörungsmythen

53/

skepticalscience.com/translationblo…

• • •

Missing some Tweet in this thread? You can try to

force a refresh